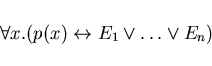

Consideriamo il programma

la cui interpretazione intuitiva è ovvia.

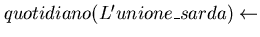

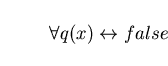

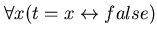

Sembrerebbe ragionevole poter inferire che vale

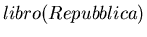

, ma ciò non è possibile usando la risoluzione SLD. D'altra parte

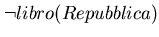

, ma ciò non è possibile usando la risoluzione SLD. D'altra parte

non è conseguenza logica del programma: infatti esistono modelli in cui

non è conseguenza logica del programma: infatti esistono modelli in cui

è una formula vera.

è una formula vera.

Tale fatto è generale: consideriamo infatti un programma logico P e un atomo A

(base di Herbrand associata a P).

Si ha che A è conseguenza logica di P se P

(base di Herbrand associata a P).

Si ha che A è conseguenza logica di P se P

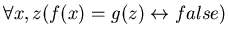

è insoddisfacibile. Non possiamo perciò mostrare che

è insoddisfacibile. Non possiamo perciò mostrare che  è conseguenza logica di P, dal momento che P

è conseguenza logica di P, dal momento che P è sempre soddisfacibile, avendo

è sempre soddisfacibile, avendo  come modello.

come modello.

Poiché non è conveniente, per problemi di intrattabilità computazionale, avere a disposizione un theorem prover corretto e completo per la logica del primo ordine, sono necessarie regole speciali per la deduzione di informazione negativa.

Un primo approccio è la Closed World Assumption (CWA), proposta da Reiter [Reiter78], che consente di derivare  , con

, con

, ogni volta che da P non è possibile dimostrare (in particolare con la risoluzione SLD) A.

, ogni volta che da P non è possibile dimostrare (in particolare con la risoluzione SLD) A.

Tale regola di inferenza non è effettiva perché in generale non si può stabilire in tempo finito che un certo atomo segue logicamente da un dato programma.

Quindi si sono cercate regole più deboli della CWA ma effettive. La negazione come fallimento finito (n.a.f.) [Clark78] permette di estendere la risoluzione SLD consentendo di dimostrare la negazione di goal ground quando il goal positivo corrispondente ha un numero finito di derivazioni finite, e tutte falliscono.

Più formalmente definiamo l'insieme di fallimento finito SLD  come l'insieme degli atomi ground A

come l'insieme degli atomi ground A

tali che esiste un albero SLD finitamente fallito con radice

tali che esiste un albero SLD finitamente fallito con radice  .

Quindi se

.

Quindi se  allora A non è conseguenza logica di P.

allora A non è conseguenza logica di P.

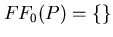

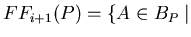

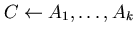

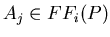

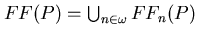

In generale si definisce la nozione di fallimento finito associato ad un programma logico nel modo seguente:

per ogni istanza ground

per ogni istanza ground

di una clausola in P, o A e C unificano, o

di una clausola in P, o A e C unificano, o

per qualche

per qualche  in

in ![$[1,k] \}$](img185.png)

è detto l'insieme di fallimento finito di P;

è detto l'insieme di fallimento finito di P;

La regola di negazione come fallimento finito è così la seguente:

se  allora si inferisce

allora si inferisce  .

.

Si può notare come la n.a.f., pur essendo più debole della CWA poiché vale che se  allora secondo CWA si deduce A, ma non il viceversa, è una regola effettiva e, dal momento che è facilmente implementabile in sistemi che fanno uso della risoluzione SLD, è la regola più frequentemente adottata per trattare la negazione.

allora secondo CWA si deduce A, ma non il viceversa, è una regola effettiva e, dal momento che è facilmente implementabile in sistemi che fanno uso della risoluzione SLD, è la regola più frequentemente adottata per trattare la negazione.

Operazionalmente, però, non si può far ricorso ad una generica regola di computazione per decidere l'esistenza di un albero SLD finitamente fallito. Si possono verificare casi in cui l'albero di derivazione risulta infinito.

Per caratterizzare operazionalmente  si è quindi definito il concetto di risoluzione SLD fair.

Una derivazione SLD è detta fair se è finita oppure è tale che, per ogni atomo B che vi compare, (una variante di) B viene prima o poi selezionata.

Una regola di computazione R è fair se ogni derivazione SLD che usa R è fair.

Un albero SLD è detto fair se ogni suo cammino corrisponde ad una derivazione fair.

si è quindi definito il concetto di risoluzione SLD fair.

Una derivazione SLD è detta fair se è finita oppure è tale che, per ogni atomo B che vi compare, (una variante di) B viene prima o poi selezionata.

Una regola di computazione R è fair se ogni derivazione SLD che usa R è fair.

Un albero SLD è detto fair se ogni suo cammino corrisponde ad una derivazione fair.

Vale il seguente risultato che esprime la correttezza e la completezza della risoluzione SLD fair come implementazione della negazione come fallimento finito:

Dati un programma logico P ed un atomo  , le seguenti affermazioni sono equivalenti:

, le seguenti affermazioni sono equivalenti:

, ovvero esiste un albero SLD con radice

, ovvero esiste un albero SLD con radice  finitamente fallito

finitamente fallito

è finitamente fallito

è finitamente fallito

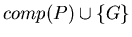

La completezza e la correttezza della regola di negazione come fallimento finito è stata dimostrata per una particolare teoria, il completamento di P comp(P) [Clark78], che intuitivamente rappresenta tutta la conoscenza espressa dal programma.

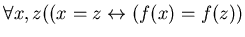

Dato un programma P, comp(P) si ottiene nel seguente modo:

ogni clausola di P del tipo

Se un predicato q di P non è definito nel programma, si assume che il completamento di q sia

Denotiamo con  l'insieme delle definizioni completate dei predicati di P.

l'insieme delle definizioni completate dei predicati di P.

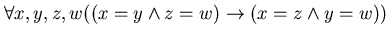

È necessario disporre di una teoria che caratterizzi il predicato =; i seguenti assiomi definiscono la teoria dell'uguaglianza  , che modella l'unificazione standard.

, che modella l'unificazione standard.

, con t termine non variabile che non contiene x

, con t termine non variabile che non contiene x

, con f,g simboli di funzione del linguaggio e

, con f,g simboli di funzione del linguaggio e  .

.

Per indicare comp(P), è usata anche la notazione  .

.

Il seguente risultato esprime il fatto che l'informazione positiva che può essere dedotta da comp(P) è esattamente la stessa deducibile da P.

Sia P un programma logico, G un goal e  una risposta per

una risposta per  . Allora

. Allora  è una risposta corretta per

è una risposta corretta per

se e solo se

se e solo se  è una risposta corretta per

è una risposta corretta per  .

.

La controparte procedurale alla definizione dichiarativa appena esposta è la risoluzione SLDNF, ottenuta estendendo la risoluzione SLD con la regola di negazione come fallimento finito.

La proprietà di correttezza di tale risoluzione è vincolata all'uso di una regola di calcolo con opportune caratteristiche, come evidenziato dal seguente esempio:

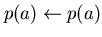

Consideriamo il programma generale P

Se il letterale  può essere selezionato, si ottiene un albero SLDNF finitamente fallito per

può essere selezionato, si ottiene un albero SLDNF finitamente fallito per

, perché esiste una refutazione di

, perché esiste una refutazione di

nella quale x è legato ad a. D'altra parte,

nella quale x è legato ad a. D'altra parte,  non è conseguenza logica di comp(P).

non è conseguenza logica di comp(P).

La regola di calcolo R necessaria è la seguente:

è il letterale negativo ground selezionato, R tenta di individuare una derivazione SLDNF finitamente fallita per A prima di continuare con il resto della computazione.

è il letterale negativo ground selezionato, R tenta di individuare una derivazione SLDNF finitamente fallita per A prima di continuare con il resto della computazione.

Quindi i sottogoal negativi possono esssere visti come lemmi che devono essere provati, per mezzo sempre della risoluzione SLDNF, prima di proseguire nel calcolo. Il fatto che possono essere selezionati solo sottogoal negativi ground implica che i legami delle variabili sono calcolati solo dalle chiamate con successo a sottogoal positivi. Perciò la negazione come fallimento è solo un test.

A Clark è dovuto il risultato di correttezza della risoluzione SLDNF rispetto al completamento di un programma:

Dati un programma generale P e un goal generale G, se  ha un albero SLDNF finitamente fallito, allora G è una conseguenza logica di comp(P).

ha un albero SLDNF finitamente fallito, allora G è una conseguenza logica di comp(P).

Per quanto riguarda la proprietà di completezza della risoluzione SLDNF, il seguente esempio mostra che non vale in generale:

Dato il programma logico P

vale comp(P)

. Ma il goal

. Ma il goal

non ammette una refutazione SLDNF perché non esiste alcun albero SLD con radice

non ammette una refutazione SLDNF perché non esiste alcun albero SLD con radice

finitamente fallito.

finitamente fallito.

Per ottenere la proprietà di completezza, si è dovuto ricorrere a restrizioni sintattiche sui goal e sulle clausole del programma. In questo modo si cerca di evitare il problema del floundering che consiste nell'ottenere durante una derivazione SLDNF un goal che contiene solo letterali negativi non ground, i quali non possono essere selezionati, per come è definita la regola di calcolo safe.

Poiché il verificarsi di tale problema è indecidibile nel caso di programmi logici, sono state individuate particolari condizioni che garantiscono l'assenza del floundering.

Un esempio è la nozione di allowedness [Llo87]:

è allowed se ogni variabile di G appare in un letterale positivo di G e ogni variabile di una clausola di P compare nel corpo della clausola.

è allowed se ogni variabile di G appare in un letterale positivo di G e ogni variabile di una clausola di P compare nel corpo della clausola.

La prima condizione garantisce che tutti i letterali negativi di G sono ground non appena G non contiene letterali positivi, mentre la seconda garantisce che tutti i fatti del programma sono ground. Se vale che

è allowed si dimostra che ogni derivazione di G non genera floundering e che ogni risposta calcolata è ground.

è allowed si dimostra che ogni derivazione di G non genera floundering e che ogni risposta calcolata è ground.